史上最大芯片是里程碑,还是“里程悲”?

用一片12吋晶圆产出一颗芯片,这简直就是暴殄天物。要知道一片12吋晶圆目前大客户的合约单价也能达到100美元以上,兴建一条12吋晶圆产线更是需要超过200亿元人民币。也有业内人士这样点评:最大芯片是怎么来的?它的尺寸是因为现在量产晶圆最大就这么大,晶体管数量是因为16nm只能够放进去这么多。

难道,史上最大的芯片就是博众人眼球的作品。然而,当你知道这个每边长大约9英寸的芯片能够实现什么的时候,可能你又会觉得这样做也不是不可以。

史上最大芯片诞生

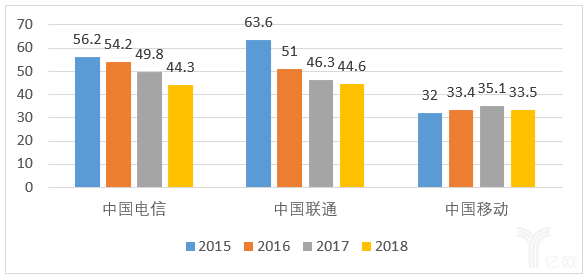

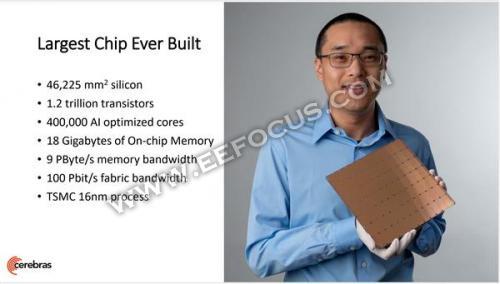

根据外媒的报道,这颗大芯片采用台积电16nm制程制造,面积42225 平方毫米,拥有1.2万亿个晶体管,400000 个核心,片上内存18 Gigabytes,内存带宽19 PByte/s,fabric带宽100 Pbit/s。它就是近几天火爆网络的史上最大芯片Cerebras Wafer Scale Engine(以下简称:Cerebras WSE)。

Cerebras WSE由人工智能初创公司Cerebras Systems(以下简称:Cerebras)推出,该公司成立于2016年,并在当年拿到了来自于Benchmark的2500万美元的A轮投资。值得一提的是,有机构在2017年全球五大值得关注的AI芯片公司榜单中就列举了Cerebras。

Cerebras的创始人是芯片业界的老兵——50岁的Andrew Feldman,他也是这家公司的CEO。浏览他的过往履历会发现,他还曾参与创立小型服务器公司SeaMicro,同样出任CEO,后来这个公司卖给了AMD,作价3.34亿美元。此后,Andrew Feldman在AMD做了两年半的副总裁。

准确地说,Cerebras带有一定的光环,但并不耀眼,如果不是这个史上最大芯片的出现甚至可以说有一点名不见经传。但是,随着Cerebras WSE发布之后,全球芯片界都在关注这颗芯片、这家公司,甚至是这家公司的员工。

和我们过往习惯的“摩尔定律”相反,这颗芯片走向了另一个“极端”,试想如果晶圆尺寸允许,可能它的边长甚至会超过9英寸。当然这只是设想。

如此巨大的芯片能够干什么呢?

首先是算力的大幅度提升。让我们重温一下这些恐怖的数字:1.2 万亿个晶体管和400000 个核心。如果以纯数字论来说,前一个数字并不是目前最高的,三星在实现闪存芯片eUFS时做到了2万亿个的数量。区别在于Cerebras WSE专为流程加工而设计,以能够让400000个核心高性能运转,它就是一个超级计算机。让人吃惊的一点是,Cerebras不仅给了Cerebras WSE更多的AI核心,并且在计算方式上也高人一筹,芯片内部采用的稀疏线性代数核(Sparse Linear Algebra Cores, SLAC),永远不会乘以零,这让算力得到了更充分的利用。Feldman表示,Cerebras WSE训练AI系统的速度可以比现有硬件快100到1000倍。

当然,Cerebras WSE不仅是算的更快,而且其存储性能也是和算力匹配的,高于目前主流GPU内存性能的3000倍。片上内存18 Gigabytes的威力可见一斑。再配备以19 PByte/s的内存带宽,这让该芯片不仅存的够多,也存的够快。

针对目前AI行业饱受诟病的延迟问题,这颗芯片也给出更优解。Cerebras WSE通过Swarm通信结构连接在一个带有100 Pb/s带宽的2D网格中。对于每个神经网络,Swarm提供独特且优化的通信路径。因此,该芯片也具备更出色的高带宽和低延迟性能。

对于史上最大芯片的发布,国内外科技爱好者都是一片叫好。

Linley Group首席分析师Linley Gwennap表示:“Cerebras凭借其晶圆级技术实现了巨大的飞跃,在单片硅上实现了比任何人想象的更多的处理性能。”

Tirias Research首席分析师兼创始人Jim McGregor讲到:“随着人工智能的发展,硅和平台解决方案也在不断发展。Cerebras WSE是半导体和平台设计领域令人惊叹的工程成就,可在单晶圆级解决方案中提供超级计算机的计算,高性能存储器和带宽。”

专用处理器和SoC架构师唐杉兴奋地说:“膜拜一下Cerebras的巨型芯片,每边大约9英寸,22cm。我记得我之前写文章还画过一个类似的对比图。[机智]Wired的文章,看来Cerebras要走到前台了。”

……

大芯片并不是突发奇想

将芯片做大并不是Cerebras的首创,早在上世纪七八十年代就已经有人开始做这方面的尝试了。

1980年成立的Trilogy当时拿着2.3亿美元的资金做超大芯片,不过由于难度过大,该项目仅仅持续了5年时间。

近一两年,半导体产业信赖的“摩尔定律”进展迟缓之后,先进封装工艺和超大芯片都开始被重点关注,且都取得了一定的成果。

大家一定对一年半以前的英伟达GTC(GPU Technology Conference)大会记忆犹新,因为就是这场盛会,让我们有幸见证了史上最大、最贵GPU的诞生。这款GPU的名字是Nvidia DGX-2。

DGX-2双板总计16块GPU,总计512GB HBM2 存储,具有12个NVSwitch。DGX-2 的算力可达 2 千万亿次浮点运算,功耗 10 千瓦。当然,这样做的成本也是高昂的,这个最大的GPU售价达到了39.9万美元。

对于英伟达DGX-2的发布,英伟达CEO黄仁勋表示:“人生完整了。”

显然,市场对于英伟达发布的最大GPU并不买账,发布会之后英伟达股价跌幅达到了6.64%。

说完最大的GPU,我们看一下最大的FPGA。就在几天前,各大FPGA粉丝群里面有一个新闻刷屏了,那就是赛灵思推出了史上最大的FPGA芯片“Virtex UltraScale+ VU19P”。该芯片拥有多达350亿个晶体管,密度在同类产品中也是最大的,相比上代Virtex UltraScale VU440增大了1.6倍,而功耗降低了60%。从晶体管数量来看,超过了AMD 64核心的二代霄龙和英伟达GV100。

马克杯口大小的FPGA,汽车后备箱大小、重大300斤的GPU,还有就是一片晶圆一颗芯片的Cerebras WSE。到底是什么在驱动芯片越做越大?

寻觅通用人工智能的硬件最优解

不管是各界人士的评论里,还是产品的介绍里,最大芯片们都有一个共同的标签,那就是人工智能。

是的,人工智能出来了许多年,也火了许多年。但是,现在的人工智能让很多地方政府和投资机构觉得像“鸡肋”,实在是食之无味,弃之可惜。造成这一局面的一个很重要的原因在于,当算法在不断精进的过程中,芯片性能开始滞后,应对单一领域计算已经乏力,更不要说什么通用人工智能了。

当前的AI芯片的设计思想主要有三大类。分别是专用于机器学习的加速芯片;类脑仿生芯片;可高效计算各类人工智能算法的通用AI芯片。

GPU和FPGA性能的不断提升,以及TPU、NPU和ASIC的出现让机器学习方面应用有了快速发展,已经实现了部分落地场景。而在类脑芯片和通用AI芯片方面迟迟没有动静,因此,Cerebras WSE的出现确实让人们看到了曙光。

理想的AI芯片需要具备高度并行的处理能力,能够支持各种数据长度的按位、固定和浮点计算,芯片本身具有高端带、低延迟,在核心计算单元和内存之间有丰富的链接,在实现高性能运算的情况下兼备低功耗的特点。并且,这样的芯片还要低成本。

在Cerebras WSE出现之前,虽然英伟达推出了大型GPU这样的产品,但是大家对于实现通用AI更为认可的方式是可重构架构设计。通过这种架构设计的可重构芯片具备软件、硬件双编程的特性,硬件架构和功能随软件变化而实时动态变化,因而又被称为软件定义芯片。可重构芯片的基础思路是通过找到数据间的依赖关系,然后通过这种关系进行实践切割,然后对计算进行分配,最终实现资源的复用。

可重构芯片的基础架构

目前,可重构芯片应用到的技术主要有计算阵列重构、存储带宽重构和数据位宽重构。通过采用上述技术,软件定义的层面不仅仅局限于功能这一层面,算法的计算精度、性能和能效等都可以纳入软件定义的范畴。

在可重构芯片领域,目前主要玩家包括传统芯片公司英特尔和赛灵思,还有初创公司Cerebras、Wave computing、寒武纪、比特大陆等。

是的,你没有看错,Cerebras同样是可重构芯片的玩家之一。不过,Cerebras WSE的价值绝不仅仅是可重构,其在芯片设计和芯片制造方面都有里程碑的意义。

在芯片设计方面,Cerebras WSE绝对算是一次大胆且成功的尝试。单一芯片上做大规模的计算核心集成,节省了芯片之间传输的时间和功耗,这样的方式比传统在数据中心做训练明显更经济实惠,不仅大大提升了训练的效率,成本也有望降低。另外,其内部核心不做乘零运算,给予当前的AI芯片以提示,大大缩减了模型训练的时间,这对于当前的人工智能产业而言价值非凡。

在芯片制造方面,台积电在这颗史上最大芯片面世过程中同样居功至伟。台积电高级副总裁Brad Paulsen表示,台积电调整其设备以进行一次连续设计,而不是多个独立设计的网格,从而从300毫米的晶圆上,切割下来一个最大的正方形来做芯片。是的,有了台积电的鼎力支持才会有这颗史上最大芯片,同时也掀开了晶圆代工的新篇章。

Cerebras用最大芯片给通用AI芯片设计提供了一个全新的思路,当材料和设备的物理极限难以突破时,放大芯片的尺寸在大规模运算中不失为一种好方法。不过,就算有可重构的计算方法,Cerebras WSE也仅仅是作为多种算法的兼容,并不能让基于一种数据经过训练后得到的模型同时适应多种应用场景,这还需要算法上面做攻关。

当然,Cerebras WSE肯定不是完美的。首先第一个要解决的问题就是散热问题,不管是芯片做高,还是芯片做大,散热都是共同的难题;其次是生态问题,打破常规的芯片就需要打破常规的系统和机器;第三是算力分配问题,当年联发科“一核有难,多核围观”的窘境相信很多人都还记得,40万个内核如何协调工作是个大问题;最后是时序问题,如此巨大的芯片如何能够做到信号传输不延迟。

总结

诚然,我们对于Cerebras WSE的商用还有诸多疑问,它的散热、生态、时序等等。但是,我们不得不说,这颗芯片是超越摩尔定律路线上浓墨重彩的一笔,在AI大数据并行的应用场景中也独具优势。我们期待有一个通用的AI芯片有朝一日能够像CPU一样通用,搭载着更先进的算法跑在我们身边的智能设备中。

无论如何,Cerebras WSE都将成为世界芯片发展史上的一座里程碑。

登录

登录

注册

注册